Discord: Start an Activity

Bringen Sie den Teamgeist in Ihrem Unternehmen auf das nächste Level!

Technik

Mit dem Aufkommen von Bewegungssteuerungen und Touchscreens hat die Implementierung von Gesten und Gesten-Erkennung in der Spieleentwicklung zunehmend an Beliebtheit gewonnen. Gesten können eine neue Ebene der Interaktivität und Immersion in ein Spiel bringen und es den Spielern ermöglichen, auf physische Weise mit der virtuellen Welt auf intuitivere und natürlichere Weise zu interagieren. Die Implementierung der Gestenerkennung wird in der Spieleentwicklung hier untersucht. Dieser Artikel bietet auch einige Tipps und Beispiele, um Ihnen den Einstieg mit Hilfe der Unity Game Engine zu erleichtern.

Gesten sind physische Bewegungen, die vom Spieler ausgeführt werden und vom Spiel erkannt werden, um bestimmte Aktionen oder Ereignisse auszulösen. Die Gesten-Erkennung ist der Prozess der Identifizierung und Interpretation dieser Bewegungen, oft mithilfe von Sensoren wie Beschleunigungsmessern oder Kameras. Es gibt viele verschiedene Arten von Gesten, von einfachen Wisch- und Tippbewegungen bis hin zu komplexeren Bewegungen wie Schütteln oder Drehen des Geräts. Effektive Gesten-Erkennungsalgorithmen müssen in der Lage sein, zwischen absichtlichen Gesten und versehentlichen Bewegungen zu unterscheiden und Gesten in unterschiedlichen Geschwindigkeiten und Winkeln zu erkennen. Einige der gängigen Ansätze sind:

Beispiel 1: Im Spiel "Fruit Ninja" verwenden die Spieler ihre Finger, um über den Bildschirm zu wischen und fliegende Früchte zu zerschneiden. Das Spiel erkennt verschiedene Arten von Wischbewegungen, wie zum Beispiel vertikal oder diagonal, um die Richtung des Schnitts zu bestimmen. Durch die Implementierung der Gestenerkennung entsteht eine immersivere und intuitivere Spielerfahrung, die sich natürlicher anfühlt als das einfache Tippen auf den Bildschirm.

Beispiel 2: In "Angry Birds VR: Isle of Pigs" verwenden die Spieler eine VR-Brille und Controller, um physisch mit der Spielwelt zu interagieren. Um einen Vogel abzuschießen, zieht der Spieler die Schleuder zurück und lässt sie los, wodurch die Bewegung des Zurückziehens einer echten Schleuder nachgeahmt wird. Durch die Implementierung der Gestenerkennung kann das Spiel die Bewegungen des Spielers genau verfolgen und in spielinterne Aktionen umsetzen.

Beispiel 3: In "Dance Dance Revolution" treten die Spieler auf ein Tanzpad, um den Anweisungen auf dem Bildschirm zu folgen und Punkte zu sammeln. Durch die Erkennung der spezifischen Bewegungen der Spielerfüße kann das Spiel genau beurteilen, ob der Spieler dem Rhythmus folgt und die richtigen Schritte ausführt. Die Gestenerkennungsalgorithmen des Spiels können eine Vielzahl von Bewegungen erkennen, von einfachen Schritten bis hin zu komplexen Tanzroutinen.

Tipp 1: Bei der Implementierung der Gestenerkennung ist es wichtig, die Einschränkungen der verwendeten Hardware und Sensoren zu beachten. Zum Beispiel kann ein Beschleunigungsmesser eines Smartphones nicht so genau sein wie ein dedizierter Bewegungscontroller und Schwierigkeiten haben, absichtliche Gesten von versehentlichen Bewegungen zu unterscheiden.

Tipp 2: Gesten sollten intuitiv und leicht zu erlernen sein, aber auch genügend Abwechslung bieten, um das Gameplay interessant zu halten. Erwägen Sie die Bereitstellung visueller oder akustischer Rückmeldungen, wenn eine Geste erfolgreich erkannt wird, um die Aktionen des Spielers zu verstärken.

Tipp 3: Die Gestenerkennung kann auch dazu beitragen, die Zugänglichkeit in Spielen zu verbessern. Zum Beispiel können Spieler mit eingeschränkter Mobilität es einfacher finden, einfache Gesten wie Tippen oder Wischen auszuführen als komplexe Tastenkombinationen.

Tipp 4: Die Auswahl der geeigneten Gestenerkennungstechnologie für das Spiel ist entscheidend. Berücksichtige Faktoren wie die Zielplattform, das Budget und das gewünschte Maß an Präzision. Einige beliebte Optionen sind:

Die Implementierung der Gestenerkennung umfasst die Integration der ausgewählten Technologie in den Code Ihres Spiels. Obwohl die genauen Schritte je nach Technologie und Plattform variieren, gelten einige allgemeine Richtlinien:

Vom Konzept bis zur Umsetzung, wir helfen gerne weiter

Wähle eine geeignete Gestenerkennungslösung, die den Anforderungen des Spiels entspricht. Hinweis 4 ist hier sehr hilfreich.

Erstelle ein neues Unity-Projekt oder öffne ein vorhandenes Projekt, dem du die Gestenerkennung hinzufügen möchtest. Die richtige Unity-Version sollte hier ausgewählt sein und alle erforderlichen Plugins oder SDKs für die ausgewählte Gestenerkennungslösung.

Beim Benutzen eines externes SDK ist das Importieren des entsprechenden Pakets in das Unity Projekt sehr wichtig. Dieser Schritt kann das Herunterladen des SDKs von der offiziellen Website oder dem Unity Asset Store und das Importieren über den Unity Package Manager beinhalten.

Wenn du hardwarebasierte Lösungen wie Kinect oder Leap Motion verwendest, verbinde das Gerät mit deinem Computer und stelle sicher, dass es von Unity erkannt wird. Befolge die Anweisungen des Hardwareherstellers oder der SDK-Dokumentation, um die erforderlichen Treiber und Konfigurationen einzurichten.

Je nach verwendetem SDK oder Plugin müssen die Gestendaten erfasst werdem, um bestimmte Bewegungen zu erkennen. Dies kann den Zugriff auf Rohsensordaten oder die Verwendung bereitgestellter APIs für die Gestenverfolgung beinhalten.

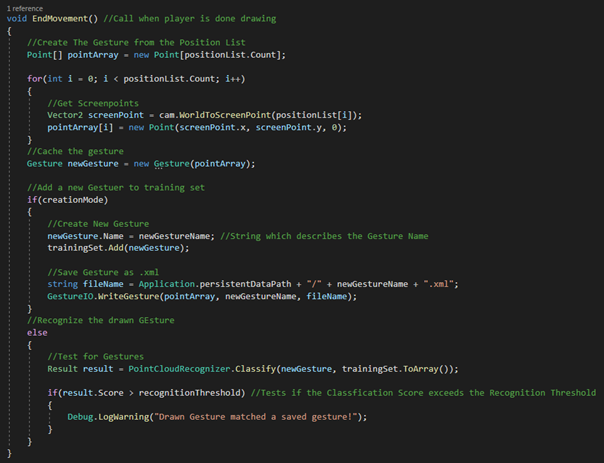

In dem Spielcode wird ein Skript oder Komponente erstellt, die die Gestenerkennungslogik behandelt. Hier sind einige allgemeine Schritte:

Nun ist das Testen des Gestenerkennungssystem des Spiels sehr wichtig, um eine genaue Erkennung und zuverlässige Leistung sicherzustellen. Überlege, die Gestenerkennungslogik und Kalibrierungseinstellungen zu verbessern, um die Reaktionsfähigkeit des Systems zu optimieren und Fehlalarme oder Fehlinterpretationen zu reduzieren.

Die Spieler benötigen visuelles oder akustisches Feedback, wenn ihre Gesten erfolgreich erkannt werden. Dieses Feedback verstärkt die Verbindung zwischen ihren Bewegungen und den Ingame-Aktionen und verbessert insgesamt das Spielerlebnis.

Die Gestenerkennungstechnologie bietet Spieleentwicklern ein leistungsstarkes Werkzeug, um die Interaktivität und Immersion in ihren Projekten zu verbessern. Indem sie Spielern ermöglicht, natürliche Körperbewegungen zur Interaktion mit Spielen zu verwenden, eröffnet die Gestenerkennung eine ganz neue Welt von Möglichkeiten für fesselnde Spielerlebnisse.

In diesem Blog-Beitrag haben wir den Prozess der Hinzufügung der Gestenerkennung zu Spieleentwicklungsprojekten untersucht und uns dabei auf Unity als Entwicklungsplattform konzentriert. Wir haben die Bedeutung des Verständnisses der Grundlagen der Gestenerkennung, der Auswahl der richtigen Technologie, der Planung und Gestaltung der Gesteninteraktionen sowie der Implementierung der Gestenerkennung in Unity besprochen. Durch durchdachtes Design, intuitive Gesten und angemessene Feedback-Mechanismen können Entwickler immersive Spielerlebnisse schaffen, die auf die natürlichen Bewegungen und Gesten der Spieler reagieren.

Die Gestenerkennung wurde bereits erfolgreich in verschiedenen Spielen wie Dance Central und Fruit Ninja implementiert und zeigt das Potenzial für verbesserte Gameplay-Mechaniken und Spielerbindung. Mit dem Fortschreiten der Technologie werden sich die Möglichkeiten der Gestenerkennung in der Spieleentwicklung weiter ausdehnen und Entwicklern aufregende Chancen bieten, die Grenzen der Interaktivität auszuloten.

Egal, ob du für Virtual Reality, mobile Plattformen oder traditionelle Konsolen entwickelst, erwäge die Integration der Gestenerkennung in dein Spieleentwicklungswerkzeug. Indem du diese Technologie annimmst und ihr kreatives Potenzial erkundest, kannst du Spieler mit einem einzigartigen und immersiven Spielerlebnis fesseln, das über traditionelle Eingabemethoden hinausgeht.

Umarme die Kraft der Gesten und lass deine Vorstellungskraft die Zukunft der Spieleentwicklung formen!

Wir hoffen, dass Dir unser Artikel gefällt und möchten Dich dazu einladen, uns Deine Gedanken und Fragen zu dem Thema mitzuteilen. Wenn Du Fragen, Kommentare oder Feedback zum Inhalt dieses Artikels hast, zögere bitte nicht, uns auch diese im Kommentarbereich anzuvertrauen. Wir freuen uns immer, von unseren Lesern zu hören und uns an sinnvollen Diskussionen über die Spieleentwicklung zu beteiligen.

Frage uns einfach alles was Du wissen willst und wir werden unser Bestes tun, um die Antworten zu geben, nach denen Du suchst. Vielen Dank für Deine Unterstützung und wir freuen uns darauf, von Dir zu hören!

No Comments

Bringen Sie den Teamgeist in Ihrem Unternehmen auf das nächste Level!

Unity modernisiert die Bentuzeroberflächen und Funktionalitäten für Developer. UIToolkit soll eine vereinfachte Lösung für UI-Element Erstellung und…

Die Unreal Engine 5 setzt in Sachen fotorealistischer Grafik neue Maßstäbe. Dabei spielen neue Rendering-Technologien wie Nanite eine entscheidende…

Write comment